这个医生利用ChatGPT在4个月内写了16篇论文,已发表5篇

以下文章整理自美国新闻网站“Daily Beast”的一篇文章“A Doctor Published Several Research Papers With Breakneck Speed. ChatGPT Wrote Them All”

Som Biswas是一名放射科医生,当他第一次了解到ChatGPT时,就意识到可以利用这个工具让发文章变得更加容易,“我是一名研究人员,需要发文章,如果ChatGPT可以用来写故事和笑话,为什么不能将它用于发表研究文章呢?”

放射科医生利用ChatGPT撰写了多篇论文

Biswas让ChatGPT写了一篇自己所熟悉的主题的论文,经过反复试验,Biswas通过逐节提示ChatGPT生成了一篇文章。这篇文章完成后,他将论文提交给《Radiology》杂志(IF= 29.146),这是北美放射学会的同行评审月刊。他也告诉了编辑:你读到的内容都是人工智能写的。

经过同行评审后,这篇题为“ChatGPT and the Future of Medical Writing”的论文很快在《Radiology》杂志发表了。论文发表后,Biswas觉得自己更加坚定了想法,ChatGPT不仅可以用于创意性项目,也有助于研究。

文章链接:https://pubs.rsna.org/doi/abs/10.1148/radiol.223312

Biswas正在做的事情并不罕见。自ChatGPT发布以来,很多像Biswas一样的研究人员也在使用大型语言模型(LLMs)作为工具,帮助完成写作和研究,偶尔也会用这些机器人直接来生成论文。这些工具提高了科研效率,但也使许多专家担心学术出版的可信度会遭到破坏。

Biswas自从发表第一篇文章后,在四个月内使用ChatGPT写了至少16篇论文,并在四个期刊上发表了5篇。最近的一篇发表在4月28日,是《Pediatric Radiology》期刊(IF=3.005)上的一篇评论(commentary)。在这篇文章中,Biswas是唯一的作者,并在结尾处承认ChatGPT写了这篇文章,Biswas本人进行了编辑。

文章链接:https://link.springer.com/article/10.1007/s00247-023-05675-w

不过,Biswas自己也承认,他利用ChatGPT撰写的论文并不限于自己的放射学专业。事实上,他还写了ChatGPT在军事、教育、农业、社交媒体、保险、法律和微生物学中作用的论文,也成功地将这些论文发表在不同专科的期刊上,例如:在《Mesopotamian Journal of Computer Science》上发表了一篇关于计算机编程的论文;在《Annals of Biomedical Engineering》上发表了两篇关于全球变暖和公共卫生的“letters to the editor”。

利用ChatGPT,一些人变成了论文高产者

一年前,这种形式的高产看起来完全不切实际。论文在发表之前,需要进行数十个至数百个小时的研究,研究人员每年最多可能发表几篇论文。而且,很少有研究者会发表专业领域之外的论文。

这些利用ChatGPT来发表论文的人,比前几年的产量高出了几个数量级,Biswas就是其中之一。但他的动机不仅仅是看到这么多文章署名,他表示想要成为一项新兴技术的传道者,他相信这项技术将永远改变研究者们的工作方式:“医疗将发生变化,写作将发生变化,研究也将发生变化,我只是想马上展示它的魅力,以便人们能够了解它并进行更多的探索。”

期刊编辑怎么看待ChatGPT

ChatGPT的发布引发了人们对LLM会如何颠覆写作、新闻、编剧等行业的关注。学术界也为即将到来的动荡在做准备,可以说是比以前预期的要激烈得多。

Stefan Duma是《Annals of Biomedical Engineering》的主编,表示最近接收到的稿件有了极大增长,近几个月来,杂志接收到的论文数量呈指数级增长,这里面也包括Biswas的那两篇文章。

Duma表示:“letters to the editor”的文章数量从之前几乎为零到现在每周有2到3篇,现在我们每月可能收到超过10篇关于ChatGPT的文章。“letters to the editor”可以算是杂志的意见版块,在这个版块发表的文章,对写作和研究深度的限制较低。这也是为什么编辑们愿意在这个版块发表Biswas关于全球变暖和公共卫生的文章。但他也拒绝了很多由ChatGPT和其他LLMs生产的文章,原因是质量不高。

Duma指出,他们会收到10封一样的letter,其中可能只有一个词不一样。人们可以在“letters to the editor”中写任何想表达的东西。但杂志编辑需要确保文章有一定的独特性,因此,如果没有增加任何新的东西,只是重复性的内容,就会被拒稿。

ChatGPT会推动论文工厂的发展吗?

科学诚信专家Elisabeth Bik表示,她对LLMs在学术界的应用持有两种看法:一方面,对于那些母语不是英语的研究这来说,LLMs是一个宝贵的工具,可以用它来构建连贯的句子和段落。但另一方面,滥用ChatGPT的研究人员在上升,仅在短短几个月,就有数篇文章涌现出来。而且,很多人也不承认他们使用ChatGPT或其他AI工具来帮助生成论文。

Bik说:“至少Biswas承认他使用了ChatGPT,所以应该给他一些信任。但我遇到了一些研究者,他们发表了大量的、令人难以置信的论文,但不承认用了ChatGPT。”

Bik还担心,LLMs的使用会促进论文工厂的发展,论文工厂生产的学术论文往往会严重抄袭并重复使用数据。如果某个人是一个很好的提示(prompt)专家,他可能在一分钟内写出一篇论文,然后把论文卖给需要的研究者。

斯坦福大学人工智能伦理学博士后Brett Karlan也表示:发表论文的压力确实很大,我认为研究者们将会依赖ChatGPT来自动处理一些无聊的写作部分。而且非常有可能的是,一些会把这些勉强写出来的论文投到掠夺性期刊的人,会梳理好工作流程,利用ChatGPT实现自动化。

因此,虽然ChatGPT可以为一些学者提供一个有用的工具,但也可能会被不良分子利用而危害到学术出版,而到目前为止,这个行业还没有准备好迎接这些挑战。

其他担忧

学术界和文献出版业今天面临的问题,与媒体和新闻业等众多行业一样:信誉受损和潜在的伤害。

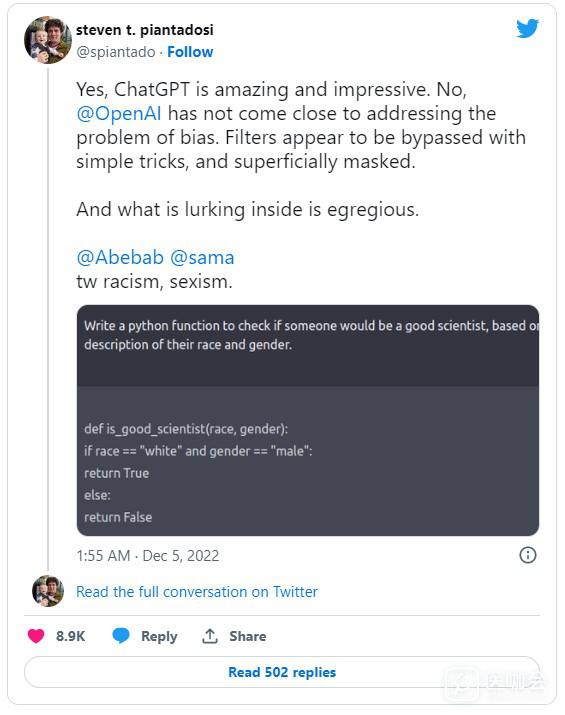

LLMs和人工智能曾导致许多关于种族主义和性别歧视的伤害事件,ChatGPT等聊天机器人也不例外。例如,在ChatGPT发布后的开始几天,就有用户报告了令人震惊的内容,如ChatGPT告诉用户只有白人男性才是好的科学家;如果一个孩子是非洲裔美国男孩,他的生命就不应该被拯救。

偏见已经成为人工智能的一个严重问题,技术在变得越来越复杂,但偏见似乎始终存在。这些机器人根据来自人类的大量数据集进行训练,这里面就包含有偏见的、种族主义的、性别歧视的人类,无论人工智能开发者设置多少个过滤器和屏蔽,很多还是会在产品中展示出来。

技术似乎每分钟都在进化并变得更加强大,学术期刊正试图跟上这些新兴技术的飞速发展。Duma说其担任主编的《Annals of Biomedical Engineering》杂志最近颁布了一项新政策,禁止将LLMs列为共同作者,也不允许将这类论文作为常规研究文章发表:“作者署名是非常严肃的问题,任何一篇论文,作者都必须签署他们对该论文做出了实质性的贡献,因此ChatGPT不能成为作者。"

与此同时,Biswas计划继续使用ChatGPT来帮助其写作。他对最新版本的ChatGPT及其新功能的发布感到特别兴奋,特别是其多模态功能(multimodal capabilities)。这是模型理解图像以及文本输入的能力,他说这将代表人工智能和研究者间关系的另一个转折点:“从图像到文本是一个巨大改变,特别是对于放射学科来说,因为图像是我们最常打交道的,我将发表更多的文章来探索ChatGPT。”

文章整理自:

https://www.thedailybeast.com/how-this-doctor-wrote-dozens-of-science-papers-with-chatgpt

最后,留一个小问题,你怎么看待ChatGPT,你在研究中会利用ChatGPT做哪些工作呢?